Après un moment de développement caractérisé par des progrès exponentiels, les générateurs d’image sont désormais accessibles à tout le monde, et l’offre s’étoffe à une vitesse hallucinante. Qu’est-ce que c’est au juste, faut-il paniquer, en quoi est-il intéressant d’y réfléchir, ou en tout cas de savoir ce qu’il se passe ? (Je ne ferai pas de prospective sur l’impact de ce genre d’outil sur la société en général, parce que ce n’est pas le sujet de ce site ; je me cantonnerai au domaine purement artistique et au point de vue du domaine du Tarot, ce qui est, on en conviendra, beaucoup plus restreint). Cet article est un reflet de mon expérience personnelle, donc subjective.

1. De quoi on parle ?

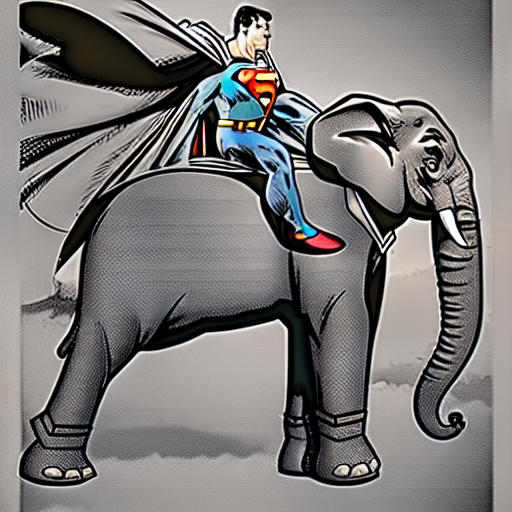

Les progrès de l’informatique sont en train de nous faire arriver à ce qui était jusqu’ici du domaine de la science-fiction : des logiciels capables de produire des images cohérentes à partir d’une description écrite. On peut donc taper « Superman sur un éléphant », et le logiciel fournit une image de Superman sur un éléphant – il n’a pas été la chercher, une telle image n’existe pas, il la crée de toutes pièces à partir de ce qu’il sait de Superman, des éléphants, et de la façon dont les gens comme Superman se tiennent lorsqu’ils chevauchent un tel animal. C’est totalement fou.

Deux-trois points techniques

Pour arriver à un tel résultat, il y a deux temps : l’apprentissage, puis la création. On commence par montrer au logiciel un maximum d’images couplées à leur description. Il va donc voir des centaines de milliers d’images d’éléphants, de face, de profil, de haut, debout, assis, au cirque, en forêt, on lui dira à chaque fois que c’est un éléphant. Le but est d’amener le logiciel à « comprendre » ce à quoi ressemble un éléphant en général, malgré les différences entre toutes les photos individuelles. Ensuite, la création se base sur un processus appelé diffusion. D’après ce que j’ai compris, quand on lui demande de produire une image d’éléphant, le logiciel commence par générer un bruit blanc constitué de points aléatoires. Il repasse ensuite dessus en essayant de chercher les groupes de points qui lui rappellent le plus ce qu’il a appris au sujet de la forme des éléphants (comme nous lorsque nous cherchons à voir des visages dans les nuages). Une fois un groupe de points identifié, il va en exagérer les caractéristiques, puis repasser dessus un certain nombre de fois, jusqu’à ce que l’image représente incontestablement un éléphant.

« Superman riding an elephant », par DreamStudio (Stable Diffusion)

Quel rapport avec notre sujet ? Pour arriver à une précision maximale, les entreprises qui développent ce type de logiciel ont fait le choix de les nourrir avec le nombre maximal d’images qu’ils pouvaient trouver, c’est-à-dire… qu’ils les ont juste lâchés sur Internet (toujours une bonne idée dans les nouvelles de science-fiction). Les robots ont donc basé leur apprentissage sur un nombre délirant d’images. Images qui leur ont montré toutes les facettes de toutes les choses, dans tous les sens. Les robots en ont alors déduit des connaissances sur les choses en général, à partir d’une immense expérience visuelle. C’est-à-dire qu’ils se sont créé des archétypes. Un archétype est un symbole particulièrement puissant parce qu’il est universel, et interprétable à l’infini, parce qu’il renvoie à une infinité d’expériences que nous avons faites tout au long de notre vie. Par exemple, l’archétype de la Grande Mère est universel parce que quelles que soient les cultures, les êtres humains naissent de mère ; il peut renvoyer aux idées d’amour inconditionnel, de soin, d’être nourri, mais aussi d’être étouffé, critiqué, menacé d’abandon, parce que l’expérience que nous faisons de la mère est extrêmement complexe et diverse. Notre robot n’a pas fait autre chose, parce que plus une idée est importante, plus il en a vu de facettes.

Chaque image qui sortira donc de ces logiciels vient donc en droite ligne de l’inconscient collectif. Puisque tout l’apprentissage est basé sur ce que toute l’humanité perçoit de toutes les choses, tout ce qui en ressortira correspondra donc forcément à la représentation, dans l’inconscient collectif, de cette chose-là.

Aléatoire, archétypes ? Faisons donc des tarots avec ça !

Il y a alors eu attaque massive de tarologues, parce que la première chose qui nous est venue à l’idée était évidemment « Viens on lui fait faire un tarot ».

Les résultats ont été mitigés, d’abord parce que ceux qui s’y sont pris trop tôt ont travaillé avec des logiciels dont l’apprentissage n’était pas aussi abouti qu’il ne l’est maintenant, ensuite parce que c’est un outil qui à mon avis n’est pas bien adapté à ce type de projet.

Voici un exemple de projet vraiment abouti généré avec Midjourney : le Tarot of the Everlasting Day Beginner Deck par Marcus Katz et Tali Goodwin (Kickstarter).

Ces images sont toutes très belles, néanmoins je ne suis pas convaincue par ce tarot. Le style est typique du logiciel Midjourney (anges en vomi de chat, bâtiments organiques qui se dressent comme des pics titanesques, humains falots voire inexistants), ce qui après le moment du choc spectaculaire finit par laisser un peu froid. Je trouve que ces perspectives fantasy impressionnantes, mais toujours à peu près les mêmes sans que cela apporte de sens particulier à l’image. Je n’ai pas l’impression que ce style frappant soit maîtrisé au point de le mettre au service d’un tarot ; pour moi, ce serait plutôt ce tarot qui serait au service de Midjourney, pour la démonstration de prouesse technique (ce qui est déjà très bien !). Ce deck est particulièrement réussi, je ne sais pas à quel point les images sont retravaillées ; je vous montre ici une sélection des plus belles, mais je n’ai pas l’impression que tout le jeu soit à ce niveau. Dans un tarot, toutes les arcanes représentent des idées très différentes les unes des autres, pour représenter la variété de l’expérience humaine. Avec ces logiciels, elles auront toutes en commun un style fantastique et déstructuré, mais je ne suis pas sûre que cela apporte beaucoup pour parler de l’humain, ce qui est tout de même la première chose que l’on demande à un tarot.

Et le refoulé dans tout ça ?

Ces logiciels sont entraînés sur un nombre immense d’images non filtrées, donc sur une forme d’inconscient collectif. Seulement, quand il y a de l’inconscient, il y a du refoulé. Où ces robots se sont-ils créé leurs archétypes ? Sur Internet, sans filtre ni sélection. Internet, ce sont des photos de chats, de vacances, de séminaires d’entreprise, des tableaux d’artistes, de la photo de mode. C’est aussi la pornographie, légale, illégale, les crimes de guerre. Pas de panique, les entreprises qui créent ces logiciels le savent bien, elles ont installé des filtres de sécurité, on ne peut pas accéder à des images de ce type-là en tapant des descriptions, tout restera bon enfant. Mais je ne peux m’empêcher de penser qu’un logiciel entraîné sur du refoulé aura du mal à sortir autre chose.

De même que les logiciels se sont entraînés sur nos images, je me suis moi-même entraînée sur DALL-E, qui appartient à la société OpenAI. Dans l’expérience que j’en ai faite, le « problème » est que l’image générée se conforme rarement à ce qu’on veut lui faire évoquer, et j’ai bien l’impression – subjective, projective – que c’est quasi exclusivement du refoulé. Ce qui me donne cette impression, c’est que DALL-E et les autres montrent vraiment toute leur puissance quand on leur demande des choses effrayantes. Même lorsqu’on ne le leur demande pas de nous effrayer, de toute façon, l’inquiétante étrangeté est là, massive : les corps sont déstructurés, la chair se confond avec la pierre et le métal, elle se tord, coule. On a vraiment l’impression de retrouver l’imaginaire torturé du cyberpunk, mais plutôt que la plume de Yukito Kishiro, c’est la psychose de Jérôme Bosch qui s’y colle, en pleine crise. Métal hurlant, vraiment…

Temperance / Devil, par Dan @Aetherial

Au final, j’ai l’impression que les tarots générés par ces logiciels ont en commun un délire assez peu maîtrisé (sauf quand l’artiste a modifié l’image au point, justement, de la maîtriser grâce à sa propre compétence). Or, l’intérêt du tarot est aussi son cadre très contrôlé, pour exprimer son inconscient de façon constructive sans recevoir le refoulé à la figure de façon destructive.

Pour l’instant, donc, je ne suis pas sûre qu’il soit possible de créer un tarot intéressant avec cet outil, à moins de vraiment beaucoup le modifier avec des compétences en illustration… c’est-à-dire, à moins de faire un tarot d’artiste, pas un tarot d’IA, et à ce moment, quel que soit l’outil utilisé, si la démarche est intéressante, le jeu sera intéressant.

2. Pas de panique pour les illustrateurs

Travailler avec l’IA demande des compétences, comme travailler avec n’importe quel outil. N’importe qui n’est pas capable de le faire ; je ne pense donc pas que les illustrateurs aient de souci à se faire, au contraire.

Basée sur l’aléatoire et le chaos, l’IA est assez incontrôlable, et l’inquiétante étrangeté ne cesse de se glisser partout. Le roi au centre d’un opéra a la tête montée à l’envers, la princesse a trois bras, la chair de la beauté alanguie sur son lit se mêle horriblement avec ses couvertures… Il faudra faire intervenir un professionnel capable de retoucher l’image pour obtenir quelque chose de cohérent.

Chaque IA a sa personnalité et il faut « apprendre à lui parler ». Cela aussi, c’est une compétence, qui s’acquiert avec l’expérience, comme on apprend à se servir d’un pinceau, d’un stylo, ou de Photoshop. Il faut aussi penser à décrire ce que l’on imagine en termes qui correspondent à quelque chose qui existe déjà, par exemple, « Batman peint par Caspar David Friedrich, peinture à l’huile ». Cela demande à la fois de connaître les réactions de l’algorithme dont on se sert (pour savoir lui parler) et l’histoire de l’art (pour l’aider à visualiser ce qu’on a en tête en lui donnant des exemples de style).

Observez cette image réalisée avec DALL-E. Je cherchais à obtenir un tableau représentant la Force telle qu’on a l’habitude de la voir en Tarot, avec une jeune femme tenant ouverte la gueule de son lion, avec confiance et amour. Au premier coup d’œil, tout va bien. Au second, arrivez-vous à voir que la gueule du lion est à la fois ouverte et fermée ? Et que les mains de la femme sont toutes deux attachées au même poignet ? On en a des frissons.

Description : « a woman lovingly holding a lion’s mouth open, full length portrait, oil painting ». Par DALL-E

Surtout, l’IA est imprévisible. Parfois, on obtient des résultats formidables, sans comprendre pourquoi. Aussi, les résultats ont beaucoup de mal à « coller » à la description donnée si celle-ci est précise. J’ai essayé moult fois d’expliquer à Midjourney que oui, l’ange de la Tempérance faisait couler de l’eau d’une coupe dans une autre, qu’il tenait la première coupe avec la main droite, et que la seconde coupe était tenue par la main gauche, et que son eau à celle-là se déversait non plus dans cette même seconde coupe, mais bien dans la première, qui était tenue par une autre main, la gauche et la droite étant bien deux mains différentes… le meilleur ange que j’aie réussi à obtenir avait vraiment l’air d’avoir été mangé puis vomi par un chat (j’ai eu de meilleurs résultats avec DALL-E en me cantonnant au style « digital art »). Bref, écrire une description pour ce type de générateur d’image est un vrai travail, qui demande une expérience particulière.

3. Un vrai outil d’inspiration

Par contre, là où l’IA se montre la plus spectaculaire, dans mon expérience, c’est justement aux moments où on lui laisse complètement la bride sur le cou, avec une description qui lui laisse la place d’interpréter la scène entièrement à sa guise. En voici quelques exemples : lisez les descriptions, et ne me dites pas que chacun ne vous inspire pas une idée, un poème, un roman.

Description : « Introspection mystique ». Par DreamStudio (Stable Diffusion)

Description : « Carte de tarot ancienne, soleil chaleureux ». Par DALL-E

Description : « As above, so below », par DALL-E

Description : « Moi et mes guides spirituels ». Par DALL-E

Description : « Connais-toi toi-même, par Léonard de Vinci », par DreamStudio (Stable Diffusion)

Description : « two hounds howling at the moon shining above a dark pond, with two crumbling towers left and right on the horizon, lovecraftian digital art », par DALL-E

Que les créateurs ne paniquent donc pas tout de suite. Pour l’instant, j’ai l’impression que ces outils sont une excellente source d’inspiration lorsqu’on les laisse faire, mais les projets qui en ressortent n’ont de sens qu’à travers le travail des artistes qui les mettront au service de leurs créations.

En politique, ces outils vont sans doute poser d’autres problèmes, mais ils sont en dehors du cadre de cet article. Je vous laisse avec une galerie d’images que j’avais tenté de créer autour de certaines cartes, toujours avec DALL-E. Je trouve leur puissance d’évocation intéressante, justement parce que le logiciel n’a pas créé exactement ce que je voulais, mais qu’il me donne « sa vision ». Lui ne voit rien du tout, bien sûr, mais l’humain qui voit cette image ne peut s’empêcher de l’interpréter – s’il y a bien une chose que l’humain ne peut pas s’empêcher de faire et dont l’ordinateur est incapable, c’est bien cela, interpréter. J’interprète donc sur ces images des tas de choses qui vont me donner, à moi, une vision différente, plus approfondie, de l’arcane sur lequel je travaillais. N’est-ce pas déjà une excellente chose ?

Bonjour et merci pour cet article/recherche, nous sommes beaucoup à nous inquiéter de l’arrivée de ces nouveaux outils et peut-être de ce fond que vous décrivez de déstructuration, productions effrayantes etc… pour le moment, on ne peut qu’espérer que cela reste un outil même si on voit le développement ultra rapide de l’IA dans tous les domaines de notre vie. On a l’impression que tous les développeurs du monde « se sont donnés le mot » pour sortir tout en même temps et dans tous les domaines provoquant chez l’humain cette peur du remplacement robotique… à l’instant T je reste convaincue que tous ceux qui savent faire avec leurs mains et leurs coeurs ont encore de beaux jours devant eux et qu’il ne faut pas oublier qu’encore maintenant plus d’électricité=plus d’IA, plus d’apports humains=plus de développement IA. Bon le sujet est très vaste et en ce qui concerne le tarot, son « mystère divinatoire » reste entier pour la plupart des personnes qui n’y voient pas leurs projections inconscientes… Vous avez réussi malgré tout à produire quelques belles images à voir vos exemples… :)

J’ai créé plusieurs jeux de tarot psychologique à partir des mythologies du monde (avant que l’IA n’arrive) en me servant de tableaux anciens que je retravaillai à l’ordinateur puis que je floutai. Il y avait donc beaucoup d’incertitude visuelle et c’est ça qui permettait aux personnes d’y trouver leur propre sens. Des gens voyaient dans l’image des détails que je n’avais jamais vu avant et qui correspondaient à leur inconscient, et le sens venait à eux. Chaque interprétation était différente. J’ai beaucoup aimé la carte de la Force ci-dessus, un seul bras 2 mains et la bouche du lion ouverte ou fermée, quelles prises de conscience en perspective ! En fait, je crois que le sens d’une image puise dans l’inconscient de son créateur et c’est ce qui lui donne sa force, c’est toujours la carte tirée au hasard qui est celle qui révèle. Donc pas de panique

Réflexion pertinente et inédite : merci pour ce partage éclairant et qui alimente notre réflexion.

Rares sont ceux comme toi qui sont en capacité de susciter un nouvel éclairage entre art numérique et arts divinatoires..

Merci beaucoup pour cet article très intéressant et instructif ! J’ai vu beaucoup d’illustrateurs anglophones s’insurger par rapport au boom de « l’AI art » et votre article m’aide à prendre du recul sur les arguments avancés. Je reste quand même persuadée que cette forme d’art (en est-ce vraiment une ?) peut poser de réels problèmes aux artistes si pas régulée ou en tout cas surveillée, mais je m’autoriserai un petit tour sur un site pour faire l’expérience moi-même !

D’ailleurs que pensez-vous des personnes commercialisant ce type de tarots ?

C’est génial! Merci de nous faire découvrir ça.